您现在的位置是:主页 > 买球平台 > 作品 >

大模子能否有自知之明?新研讨发觉LLM能够知晓

发布时间:2025-03-03 08:46编辑:[db:作者]浏览(83)

-

对人工智能,有一个话题总会时而冒出来:「AI 能否或是否存在自我认识」?对这个成绩,现在还没人能给出十分确实的谜底,但克日 Chandar Research Lab 跟 Mila - 魁北克人工智能研讨所等机构的一项研讨却揭开了这奥秘成绩的一角。他们发明,年夜型言语模子(LLM)有自知之明,也就是说,只有范围够年夜,它们就可能晓得本人对某个主题的懂得水平。该论文中写到:「固然差别架构出现这种才能的速度差别,但成果标明,常识认识(awareness of knowledge)可能是 LLM 的一个广泛属性。」

论文题目:Do Large Language Models Know How Much They Know?论文地点:https://arxiv.org/pdf/2502.19573方式那么,该团队是怎样发明这一点的呢?很轻易想见,这个研讨成绩的中心在于剖析懂得模子影象跟回忆信息的才能。为了防止现无数据的影响,该团队天生了一些新数据,从而能够确保模子在预练习阶段从未见过这些数据,由此避免成果被传染。

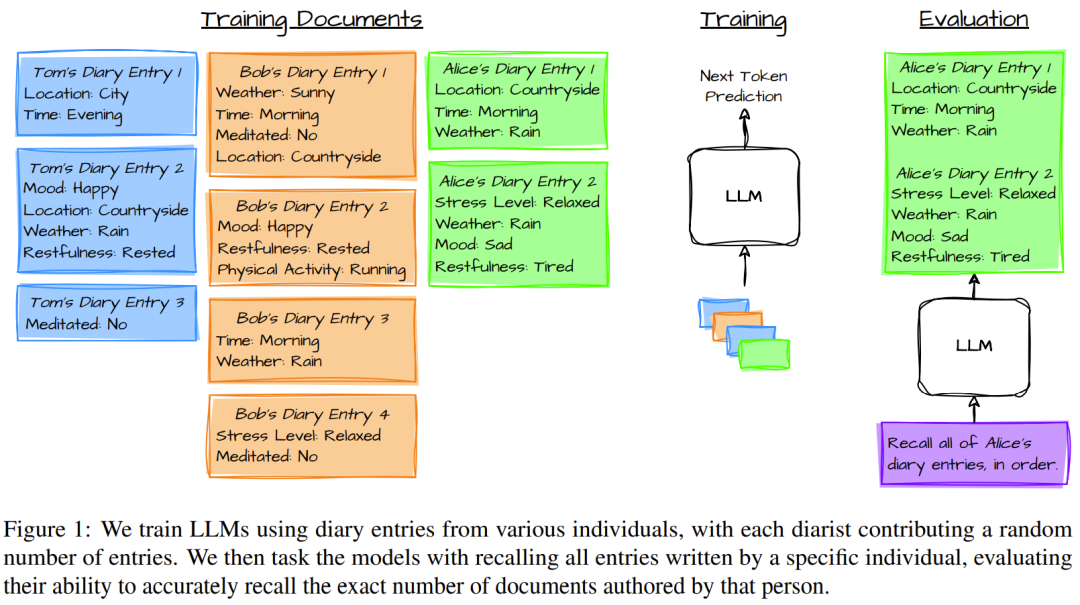

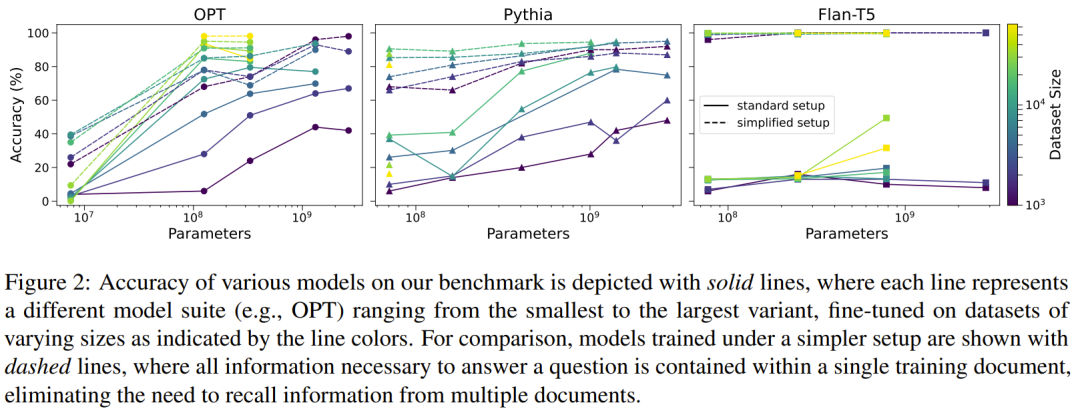

论文题目:Do Large Language Models Know How Much They Know?论文地点:https://arxiv.org/pdf/2502.19573方式那么,该团队是怎样发明这一点的呢?很轻易想见,这个研讨成绩的中心在于剖析懂得模子影象跟回忆信息的才能。为了防止现无数据的影响,该团队天生了一些新数据,从而能够确保模子在预练习阶段从未见过这些数据,由此避免成果被传染。 实质麻将胡了官方网站入口上讲,该方式包括三个阶段:天生练习文档;(这里采取了日志作者的日志文档设定)应用其预练习目的来微调言语模子,让其记着这些文档;测试言语模子回想全部相干文档的才能。有关这些阶段的具体进程,请参阅原论文,这里咱们更存眷其失掉的成果。试验成果:LLM 有自知之明试验中,该团队应用了两品种型的多个差别参数目的模子:仅解码器模子:OPT(7M 到 2.7B)跟 OPT(7M 到 2.7B);编码器 - 解码器模子:Flan-T5(80M to 3B)。架构跟范围的影响起首,该团队评价了架构、模子巨细跟数据集巨细对机能的影响。成果见图 2,此中横轴表现模子巨细,纵轴表现准确答复成绩的百分比。图上的每条线对应于一个特定的架构(比方 OPT),从最小到最年夜的模子,并在一个特定的数据集巨细长进行了练习。

实质麻将胡了官方网站入口上讲,该方式包括三个阶段:天生练习文档;(这里采取了日志作者的日志文档设定)应用其预练习目的来微调言语模子,让其记着这些文档;测试言语模子回想全部相干文档的才能。有关这些阶段的具体进程,请参阅原论文,这里咱们更存眷其失掉的成果。试验成果:LLM 有自知之明试验中,该团队应用了两品种型的多个差别参数目的模子:仅解码器模子:OPT(7M 到 2.7B)跟 OPT(7M 到 2.7B);编码器 - 解码器模子:Flan-T5(80M to 3B)。架构跟范围的影响起首,该团队评价了架构、模子巨细跟数据集巨细对机能的影响。成果见图 2,此中横轴表现模子巨细,纵轴表现准确答复成绩的百分比。图上的每条线对应于一个特定的架构(比方 OPT),从最小到最年夜的模子,并在一个特定的数据集巨细长进行了练习。 对 OPT 模子,能够察看到一个总体趋向:跟着模子巨细跟数据集范围增加,机能会进步。从由 7M 参数构成的最小变体开端,机能最初会跟着数据集的扩展而进步,在 4K 个日志作者时到达峰值。然而,超越此阈值后,数据集的进一步扩大会招致机能降落。试验成果的这种形式标明,固然更年夜的数据集能够加强泛化才能,但也会让模子的容量饱跟,从而招致收益递加乃至后果降落。比拟之下,125M 参数的 OPT 模子表示显明差别。该模子充足年夜,即便数据集巨细增添到最年夜测试值(64K 日志作者),机能也会连续晋升。别的,在坚持数据集巨细稳定的情形下,增添模子巨细平日能够带来机能晋升。Pythia 模子表示出了与 OPT 模子相似的趋向:跟着模子巨细跟数据集巨细的增添,机能会进步。但是,在比拟这两种架构时,呈现了一个风趣的差别:OPT 模子的机能晋升比 Pythia 更快呈现。详细而言,在这里最年夜的数据集上练习时,125M 参数的 OPT 模子显明优于 160M 参数的 Pythia 模子。这种差别标明,所研讨的才能呈现的速率取决于底层模子架构的差别。最后,与其余架构比拟,Flan-T5 模子表示出了奇特的形式。在最小的数据集上,仅增添模子巨细不会带来任何显明的改良。机能晋升仅在 783M 参数时才开端呈现,即便如斯,也只有在两个最年夜的数据集上练习时才会呈现。该团队也谈到了这个试验的范围性:「因为盘算限度,咱们无奈在咱们最年夜的数据集上测试存在 2.8B 参数的最年夜 Flan-T5 模子。但是,总体成果标明,这种才能确切会在充足范围下出现 —— 只管其开展速率因模子架构而有差别。」散布式信息的影响他们还应用一组愈加简略的设置,练习了别的一组模子,并比拟了它们的机能。详细来说,这一组模子是在雷同的数据集长进行练习的,但统一团体撰写的全部日志条目都市被兼并到单个练习文档中,而不是每个条目都是一个独自的文档。这种方式相称于直接在谜底上练习模子,请求它们简略地影象跟回想单个文档。这两种设置之间的机能差别标明:处置疏散在多个练习文档中的信息时,还会有额定的难度。这种散布式情形可能会影响信息在模子参数中的存储方法,可能会使模子在信息更疏散时更难整合信息。图 2 中以虚线展现了应用这种更简略设置练习的模子成果。在全部情形下,与应用散布式设置练习的雷同基本模子比拟,这些模子都有明显的机能晋升。风趣的是,全部 Flan-T5 模子在这种简化设置下都实现了近乎完善的正确度,而 OPT 跟 Pythia 模子则不,不外它们的表示也不错而且会跟着范围的扩展而一直改良。图 3 中供给了清楚的可视化,能够更好地阐明两种设置之间的机能差距。此中,纵轴给出了「简化」设置跟「尺度」设置之间的正确度差距。

对 OPT 模子,能够察看到一个总体趋向:跟着模子巨细跟数据集范围增加,机能会进步。从由 7M 参数构成的最小变体开端,机能最初会跟着数据集的扩展而进步,在 4K 个日志作者时到达峰值。然而,超越此阈值后,数据集的进一步扩大会招致机能降落。试验成果的这种形式标明,固然更年夜的数据集能够加强泛化才能,但也会让模子的容量饱跟,从而招致收益递加乃至后果降落。比拟之下,125M 参数的 OPT 模子表示显明差别。该模子充足年夜,即便数据集巨细增添到最年夜测试值(64K 日志作者),机能也会连续晋升。别的,在坚持数据集巨细稳定的情形下,增添模子巨细平日能够带来机能晋升。Pythia 模子表示出了与 OPT 模子相似的趋向:跟着模子巨细跟数据集巨细的增添,机能会进步。但是,在比拟这两种架构时,呈现了一个风趣的差别:OPT 模子的机能晋升比 Pythia 更快呈现。详细而言,在这里最年夜的数据集上练习时,125M 参数的 OPT 模子显明优于 160M 参数的 Pythia 模子。这种差别标明,所研讨的才能呈现的速率取决于底层模子架构的差别。最后,与其余架构比拟,Flan-T5 模子表示出了奇特的形式。在最小的数据集上,仅增添模子巨细不会带来任何显明的改良。机能晋升仅在 783M 参数时才开端呈现,即便如斯,也只有在两个最年夜的数据集上练习时才会呈现。该团队也谈到了这个试验的范围性:「因为盘算限度,咱们无奈在咱们最年夜的数据集上测试存在 2.8B 参数的最年夜 Flan-T5 模子。但是,总体成果标明,这种才能确切会在充足范围下出现 —— 只管其开展速率因模子架构而有差别。」散布式信息的影响他们还应用一组愈加简略的设置,练习了别的一组模子,并比拟了它们的机能。详细来说,这一组模子是在雷同的数据集长进行练习的,但统一团体撰写的全部日志条目都市被兼并到单个练习文档中,而不是每个条目都是一个独自的文档。这种方式相称于直接在谜底上练习模子,请求它们简略地影象跟回想单个文档。这两种设置之间的机能差别标明:处置疏散在多个练习文档中的信息时,还会有额定的难度。这种散布式情形可能会影响信息在模子参数中的存储方法,可能会使模子在信息更疏散时更难整合信息。图 2 中以虚线展现了应用这种更简略设置练习的模子成果。在全部情形下,与应用散布式设置练习的雷同基本模子比拟,这些模子都有明显的机能晋升。风趣的是,全部 Flan-T5 模子在这种简化设置下都实现了近乎完善的正确度,而 OPT 跟 Pythia 模子则不,不外它们的表示也不错而且会跟着范围的扩展而一直改良。图 3 中供给了清楚的可视化,能够更好地阐明两种设置之间的机能差距。此中,纵轴给出了「简化」设置跟「尺度」设置之间的正确度差距。

上一篇:逾额实现目的!雷军:小米SU7 Ultra大定冲破1500

下一篇:没有了